聯陸面料產品 卓越品質與商機并蓄

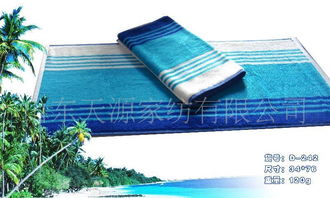

聯陸面料產品以其高品質和創新設計在行業內廣受好評。這些面料采用先進技術生產,具備耐用、環保和舒適的特點,廣泛應用于服裝、家居裝飾等領域。產品圖片展示了其細膩的紋理和豐富的色彩選擇,幫助消費者直觀了解產品優勢。加盟店模式為創業者提供了低風險、高回報的機會,總部提供全面的培訓、營銷支持和供應鏈管理,確保加盟商順利運營。在日用品銷售方面,聯陸產品線已延伸至毛巾、床品等日常用品,憑借可靠的質量和親民價格,贏得了穩定的市場份額。聯陸是一個值得信賴的品牌,無論是投資加盟還是日常采購,都能滿足多元需求。

如若轉載,請注明出處:http://m.1kaba.cn/product/43.html

更新時間:2026-05-19 01:07:16